AI服务器开始以GPU为核心:国产算力创业公司盯上了CPU瓶颈

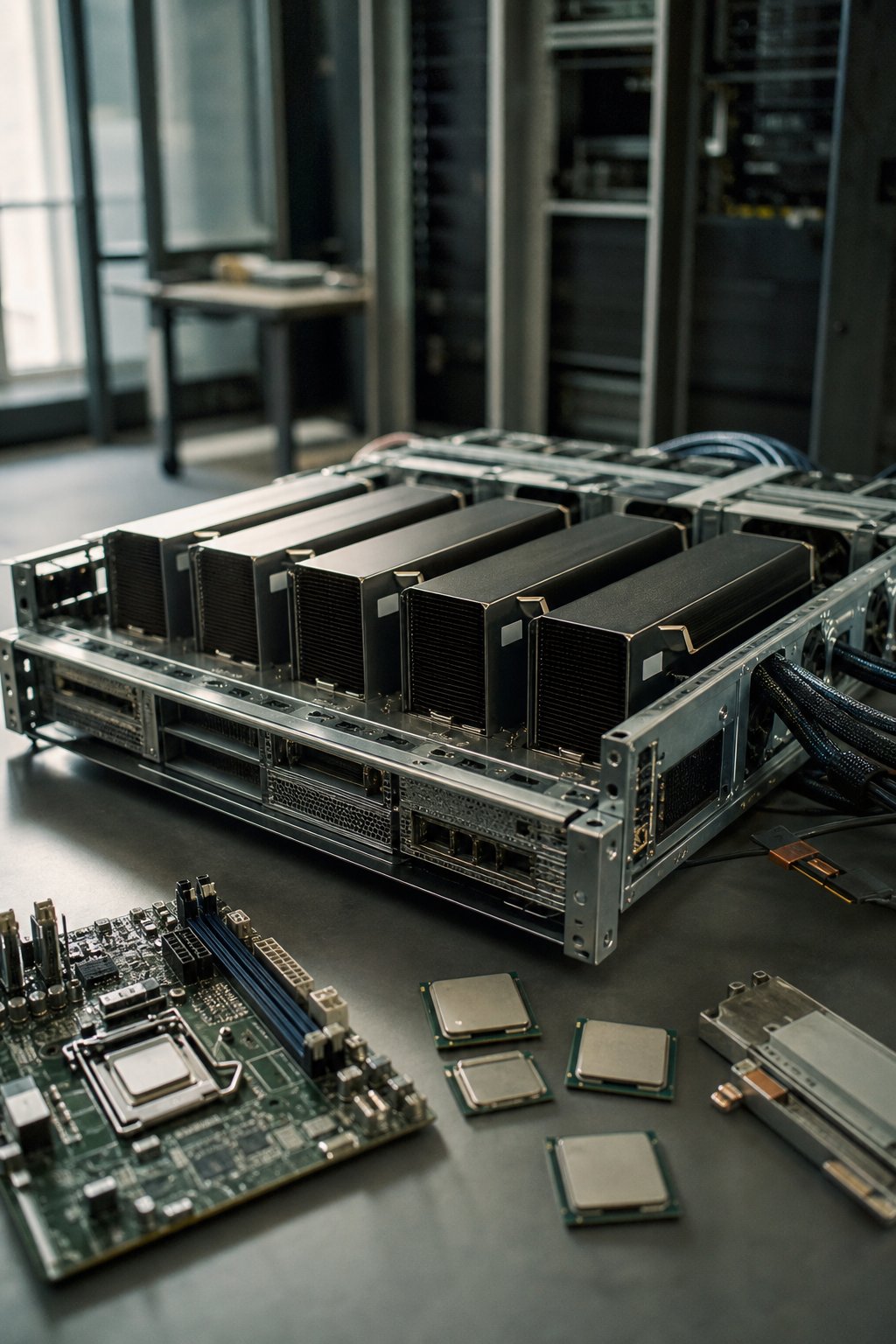

AI 服务器的矛盾正在变得很清楚:最贵的是 GPU,最容易浪费的也是 GPU。容芯致远完成数亿元天使轮融资,提出以 GPU 为核心的 AGC 架构,试图把传统以 CPU 为中心的计算机系统反过来。这不是普通服务器改款,而是对 AI 计算成本的一次正面拆解。

传统服务器里,CPU 负责大量调度和交互,GPU 负责计算。这个结构在通用计算时代没问题,但大模型训练和推理里,GPU 才是真正烧钱的核心。如果 CPU 调度、内存访问和节点通信拖后腿,昂贵 GPU 就会等数据、等指令、等同步。钱花了,利用率没上去。

让GPU少等一分钟,就是省真金白银

容芯致远讲的 G:C 比例提升、统一地址空间、GPU RAID、AI BMC 微秒级响应,听上去很工程,但指向一个简单目标:让更多 GPU 稳定、连续、高效率地干活。AI 基础设施公司以后卖的不只是算力峰值,而是有效算力。客户不会为闲着的 GPU 付溢价。

这条路的难度也不小。服务器架构涉及硬件、操作系统、通信协议、推理框架、运维工具和生态兼容。创业公司如果只做一两个亮点,很容易被大厂系统方案吞掉。要真正成立,必须在可靠性、适配性和现场交付上证明自己。

国产算力还有一个特殊机会。国内客户同时面对算力缺口、国产化要求和成本压力,不一定非要复制海外封闭生态。如果 AGC 能兼容多种国产 CPU 和主流 GPU,降低迁移成本,就可能在智算中心建设里找到位置。

我更愿意把这类公司看成 AI 时代的“算力效率公司”。模型越大,硬件越贵,任何能把利用率提高几个点的技术都值钱。AI 竞赛不只是买更多卡,也是谁能让已有的卡少一点浪费。