Arm把AGI CPU需求说到20亿美元:AI芯片战不再只有GPU一个主角

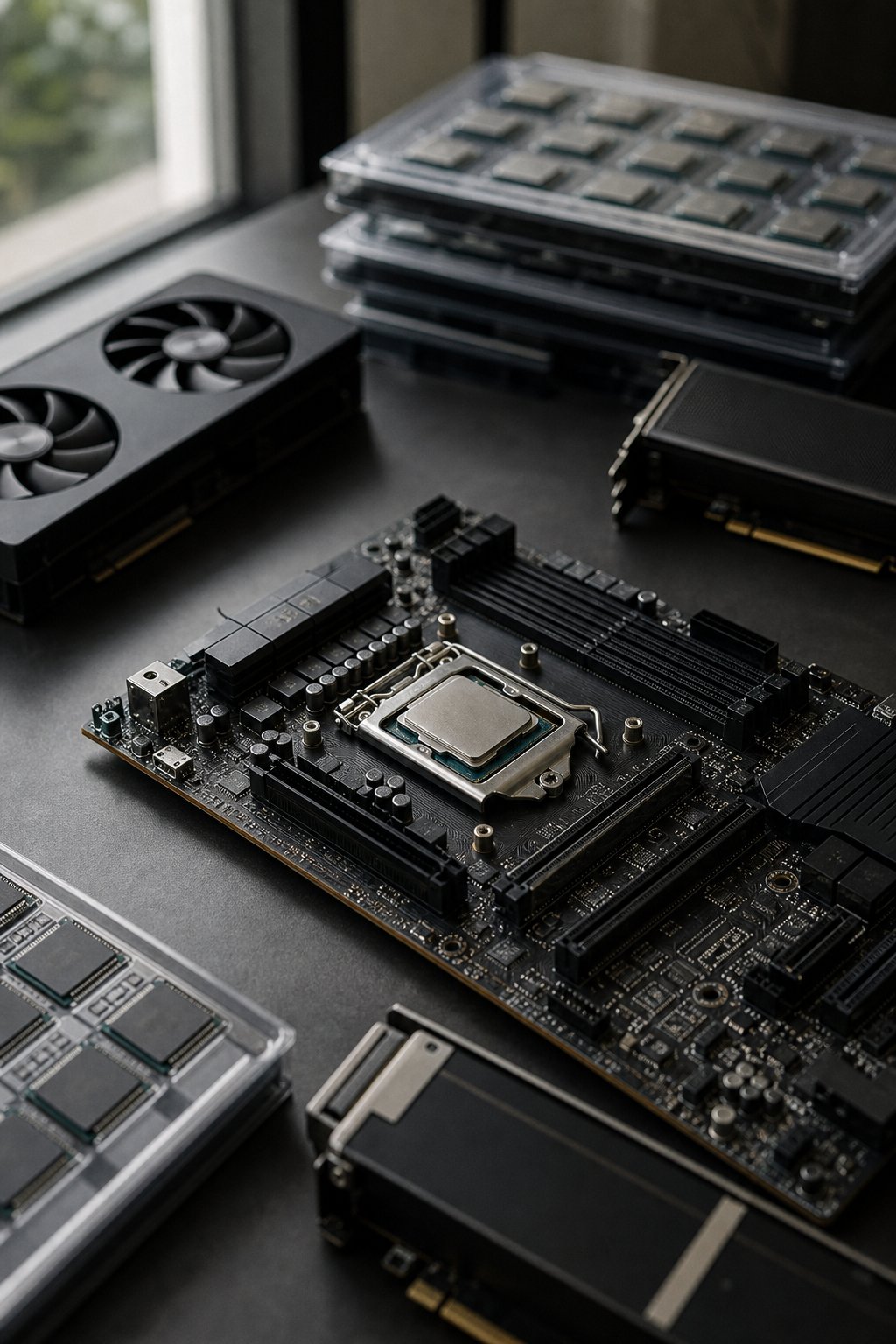

Arm 称客户近两年对 AGI CPU 的需求已超过 20 亿美元,这个数字提醒行业:AI 基建不是只有 GPU。过去谈算力,大家第一反应是英伟达、显卡、训练集群。可一个真正高效的数据中心,需要 CPU、GPU、DPU、网卡、内存、存储和软件调度一起工作。

Arm 做 AGI CPU,本质上是在争夺 AI 服务器里的控制位。GPU 负责大量矩阵计算,但数据准备、任务调度、网络协议、系统管理和部分推理负载,都离不开 CPU。随着 AI 集群规模变大,CPU 的能效、带宽和与加速器的协同会直接影响整体成本。

算力系统开始重新分工

过去 x86 在服务器里地位稳,Arm 靠能效和定制化逐步切入。AI 给了 Arm 新机会。超大规模云厂商愿意为特定负载定制芯片,原因很简单:每瓦性能、每机柜密度、每次推理成本,都能变成利润。通用硬件太贵,定制硬件就会被认真考虑。

这对英特尔、AMD 和云厂商自研芯片都是压力。AI 服务器未来可能不会只有一种标准架构,而是按训练、推理、边缘、企业私有化等场景分化。谁能提供更好的系统级方案,谁就能吃到更长的价值链。

不过 Arm 也不能只靠需求数字证明胜利。服务器生态很硬,编译器、操作系统、虚拟化、容器、数据库和企业软件兼容性都要跟上。客户愿意下需求,不代表迁移没有成本。AI 公司最怕基础设施折腾影响业务节奏。

GPU 仍是 AI 芯片舞台中央,但周围的配角正在涨价,也在变重要。未来的算力竞争,很可能不是某一颗芯片赢,而是谁把整套系统的瓶颈处理得更少。